引言

在计算机辅助药物设计中,可用于建模发现新药的数据集规模一般很小。稀疏的数据样本是人工智能药物设计的难点之一。为了解决这个难题,科学家提出了以迁移学习为代表的一类针对小样本数据集的算法。迁移学习先从一个更加广泛的相关领域中学习知识,然后在小样本数据集训练,最后得到一个模型。药物研究中最常用的是深度迁移学习模型,本文概述了迁移学习的发展和在药物研究中的应用,并讨论了迁移学习的未来发展方向。

介绍

新药研发是一个研发成本高,周期长,失败率高的工作。药物从临床到最后上市,失败率高达90%以上。因此,科学家提出了许多计算模型,它们涵盖了活性预测、虚拟筛选、逆合成分析、化合物生成等许多方面,极大提升了新药研发的效率。在药物研发早期阶段,带有标注的化合物往往不足一千,过少的数据限制了人工智能辅助药物设计的应用。这时,迁移学习从相关领域学习知识,应用在数据稀疏的场景,能取得更好的效果。

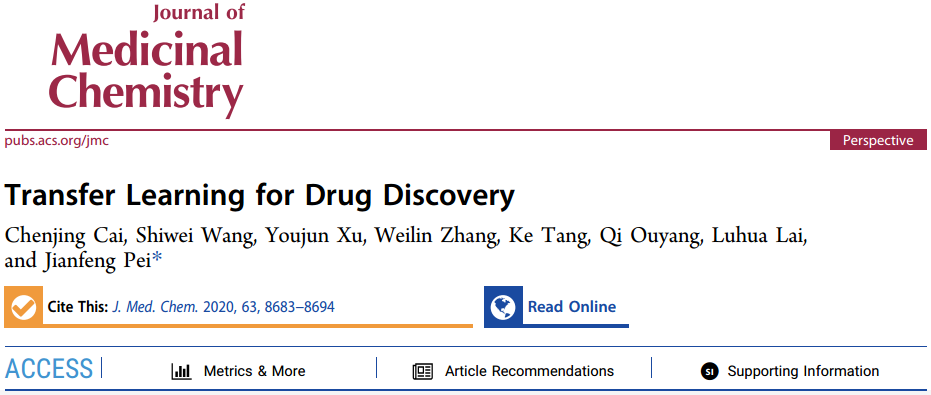

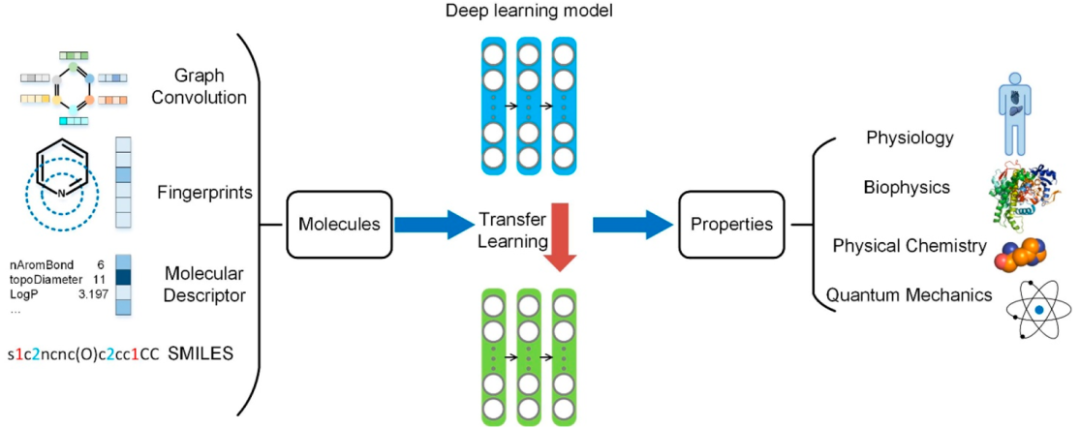

图1. 迁移学习相关方法的流程图

图片来源于JMC

迁移学习

最初,科学家尝试使用之前训练学习好的模型加速后续任务的训练,形成了迁移学习的雏形。这个思路启发了多种创新的算法,比如归纳学习、终身学习、多任务学习、元学习、持续学习等。到了2010年,迁移学习有了权威的定义。机器学习通常有一个域和一个任务。一个任务是一个预测目标。假定现在有两个问题,它们各自有一个域和一个任务。与传统的机器学习会分别建立两套不同的模型的方式不同(图1a),迁移学习尝试使用模型在一个域和任务的训练结果,来提升模型在另一个域和任务中的效果(图1b)。

迁移学习的方法可以分为四类:基于实例的迁移学习、基于特征的迁移学习、基于参数的迁移学习和基于关系的迁移学习。不同类别的组合可以取得更好的效果。

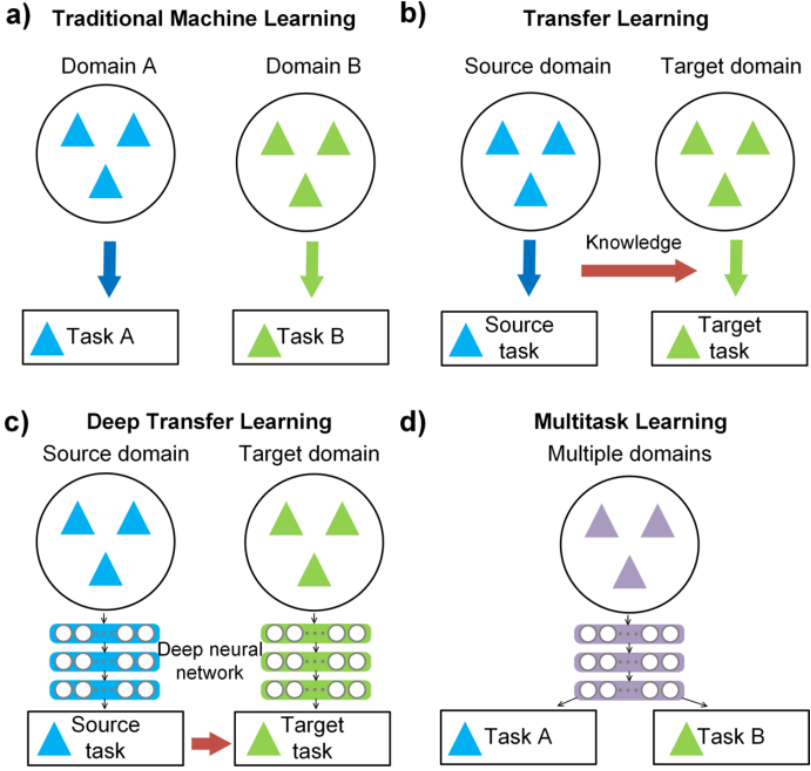

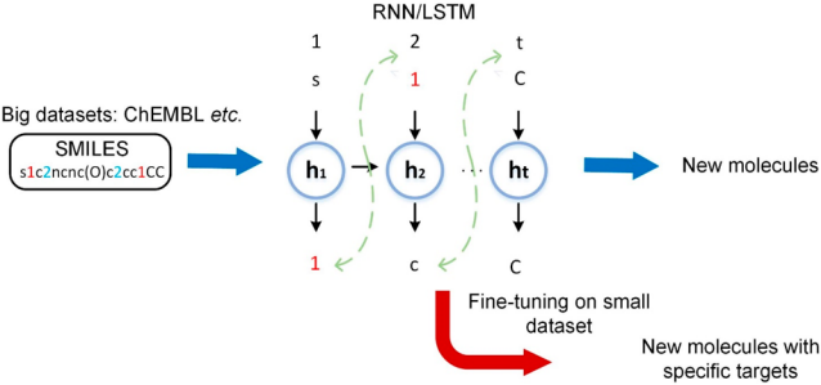

图2. 深度迁移学习的流程图

图片来源于JMC

深度迁移学习

深度迁移学习是当下的主流,它组合深度学习和迁移学习(图1c)。常见的一类迁移学习是基于参数的‘fine-tuning’ (图2a)。假定训练过的深度学习网络中的参数权重蕴含从域中习得的知识,它将这样模型作为相关领域的初始模型,训练拟合相关的目标问题,能取得更好的效果。比如,在分子生成模型中,我们通常使用一个大化合物库预训练一个模型,然后针对不同靶点的小样本数据集,微调模型生成具有特定功能的分子。Jason Yosinki在图像识别的模型中使用了预训练过的神经网络作为初始模型,结果表明迁移学习赋权重的模型训练效果优于随机赋权重的模型。后来迁移学习被广泛用于目标检测、自然语言处理、药物设计等领域。

深度迁移学习还可以用在基于特征的迁移学习中。迁移学习使用深度神经网络对样本做特征变换,将源数据集和目标数据集映射到隐特征空间,使得数据集的样本具有相似的分布,有助于改善模型在目标数据集的表现。比如说,一个分子毒性数据集和一个分子生物活性数据集,在传统机器中,他们会分别使用模型训练。如果毒性数据集样本稀少,那么就不能使用活性数据集直接去训练毒性的模型。深度迁移学习会用活性数据集构造出隐特征空间,并使得两个数据集的样本在这个空间中具有相似的分布。这里通常采用两种常用的方式维持深度学习中域特征的不变性。一是降低源域和目标域在隐空间的偏离,计算样本在隐藏层的输出,度量两个域的差异,使得网络学习的特征表示保持域不变性(图2b)。二是采用对抗的思路(图2c),使用另一个网络生成跨域的对抗样本,使得训练模型无法区分样本的来源,模型效果良好,成为近年来的研究热点。

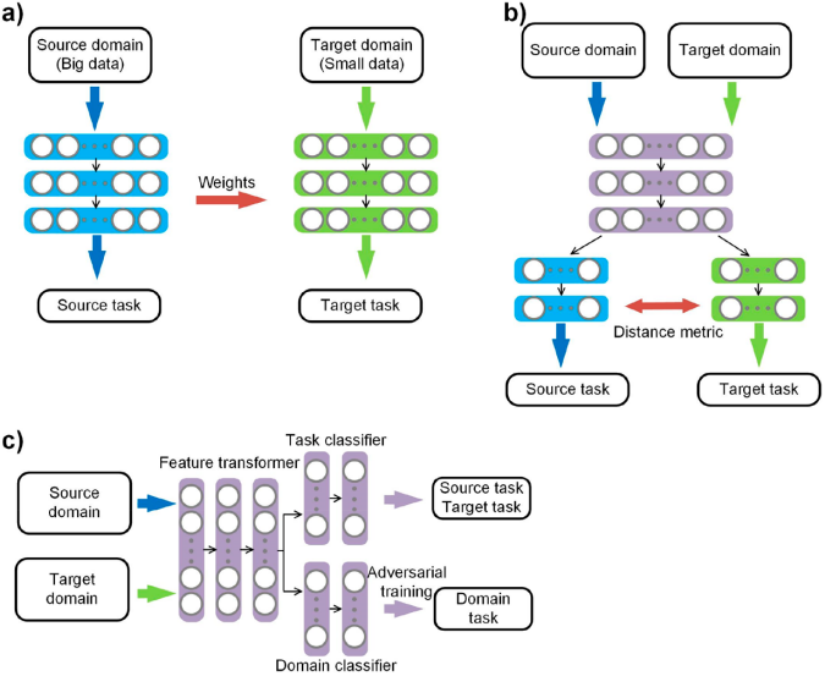

图3. 迁移学习在新药研发中的应用与常见方法

图片来源于JMC

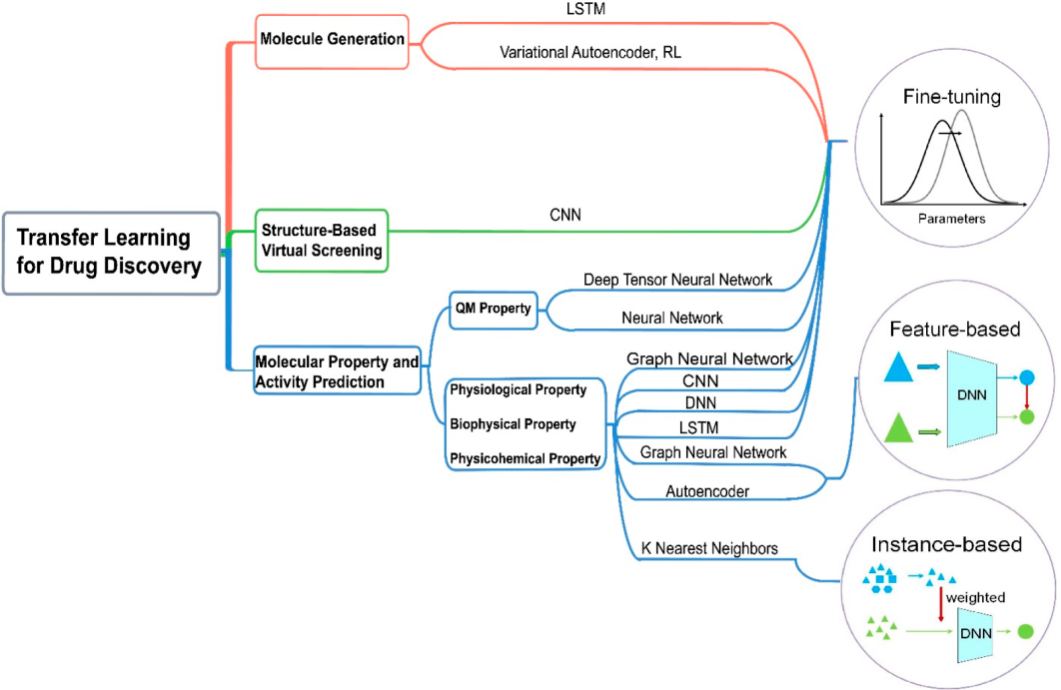

图4. 分子性质预测的迁移学习流程图

图片来源于JMC

新药发现中的迁移学习

迁移学习在新药发现中主要应用在三个场景:分子性质与活性预测、分子生成和基于结构的虚拟筛选(图3)。

迁移学习常用来解决药物研究数据稀少的问题(图4)。Girschick在QSAR中组合归纳学习和距离学习,发现这种方法在大数据集和小数据集都取得良好的效果。Smith在QM预测中,先在一个大规模、低准确度的密度泛函理论数据集上训练一个神经网络,然后在一个高准确度的小数据集上训练微调参数。模型错误率比基准模型降低了约20%。Lu也将‘fine-tuning’的方法用在分子能量预测与构象分析中,他们发现‘fine-tuning’不仅能提高预测准确率,还降低了训练时间,从十几个小时降低为数小时。Goh提出了ChemNet卷积网络模型,这个模型先在ChEMBL上预训练,再使用Tox21、HIV和FreeSolv微调。其训练效果显著优于单独使用ChemNet训练。

药物研究中还使用了基于特征的迁移学习。Lovanac使用自动编码机将所有分子映射到隐空间中提取特征,再用于pKa的预测。Abbasi在多任务学习中采用了基于对抗迁移学习的方法(adversarial domain adaptation network,ADAN)预测药物副作用。他尝试在Tox21、SIDER等数据集上做迁移学习,发现如果学习的知识与预测目标具有相关性,可提升模型效果。比如在对Tox21数据集的训练中,使用ToxCast预训练比SIDER和HIV的效果提升很多。这提示我们,预训练数据集的知识相关性比数据集规模更重要。

图5. 迁移学习的分子生成示例

图片来源于JMC

分子生成可以模拟全新药物设计,生成类药分子。在这个过程中常见的迁移学习技术是‘fine-tuning’(图5)。Segler使用含有140万个化合物的ChEMBL数据集训练一个LSTM模型,然后在一个靶点的小样本数据集上做迁移学习,提高了模型训练效率。Merk采用‘fine-tuning’的方法找到类视黄醇X受体和过氧化物酶激增剂受体(PPAR)的药物。在排名靠前的5个化合物中,4个化合物表现出了纳摩尔到微摩尔级的活性。强化学习搜索状态空间,指导模型参数的更新,促使模型生成需要的结果。迁移学习约束搜索空间,集中在局部区域,发现符合条件的分子,它严重依赖于训练的小样本数据集。在实际应用中,研究者常用迁移学习加速强化学习训练,提升了强化学习发现全新药物的能力。比如Zhavoronkov提出的生成张量强化学习,他首先在ZINC数据集中训练模型,然后迁移模型至DDR1数据集。在模型推荐的6个分子中,4个分子表现出了10 nM至1 μM的活性。

多任务学习

多任务学习使用一个模型共享权重并预测样本的多个标签,试图在所有标签预测上具有良好的表现(图1d)。多任务学习和迁移学习都是以知识共享的方式来提升模型效果。Varnek在QSAR的浅层网络中使用多任务模型,表明多任务模型的效果优于单模型的效果。在代谢预测中,Li使用自动编码的DNN预测细胞色素P450抑制剂,效果也优于单模型。在药物活性预测中,Ashrawy使用多任务学习同时预测药物的结合模式、亲和力和活性。预测效果超出了传统的对接打分模型。Feinber在GCNN模型的多任务学习中证明,多任务模型能切实提高模型的泛化能力。但是这种泛化能力仅体现在同一个预测标签在验证集和训练集间的泛化,无法提高模型在不同标签中间的泛化能力。Xu解释了多任务学习的优势:它能从训练集中相似的样本中获取有效信息,并将这些信息应用到不同的预测任务中,尤其是那些相关的任务。这些信息在样本特征和网络的层间实现了共享,间接具有数据增强的作用。

多任务学习也有自身的局限性。一是多任务学习的模式究竟是双赢模型、权衡模型还是零和模型尚无定论。共享的特征具有相互依赖的特点,任务的相关性和数据分布对模型影响较大。二是共享特征的结果也有可能是虽然提升了少数任务的效果,却牺牲了其他任务的效果。多任务模型更加适用于数据间具有相关性的场景,迁移学习则更适用于数据相关性较低的场景,因为它无需平衡任务间的效果。

讨论

迁移学习在药物研发中的应用还处于初步阶段,相关的理论还需要继续探索。比如,迁移学习的表现没有统一的评判尺度。迁移学习的效果有可能是模型复杂度带来的,不能简单地以正确率等损失函数来衡量。当前我们还缺少与药物研发相关的迁移学习的基准数据集,相关的文献也不多。当前迁移学习依旧还有需要解决的挑战。虽然研究证实数据集间的相关性比数据集规模更重要,但是现在没有量化数据集间的相关性的有效方法。目前也没有如何选用迁移学习的方法论。不当的方法会导致“负迁移”现象,反而降低了模型表现。最后,由于理论指导的缺失,迁移学习方法难以评价,因而也缺乏通用的选取标准。在药物研发中使用迁移学习时,要注意判断是否可以使用迁移学习。研究人员需要先度量数据集间的距离,比如分子指纹的相似度、化学空间距离等。采用自动编码机将分子表示成一个连续值的向量,能有效避免负迁移效应。当前迁移学习主要用的还是“fine-tuning”的方法,我们希望其他的迁移学习方法尤其是基于特征的迁移学习,能在药物研究中发挥更重要的作用。希望在未来的研究中,迁移学习方法能更充分地与其他方法组合,加速药物研发流程。

参考文献

Chenjing Cai, Shiwei Wang, Youjun Xu, Weilin Zhang, Ke Tang, Qi Ouyang, Luhua Lai, and Jianfeng Pei, Journal of Medicinal Chemistry, 2020, 63, 8683-8694. DOI: 10.1021/acs.jmedchem.9b02147